論文解説:リモートセンシングにおける深層学習のトレンド

「リモセンと深層学習の課題とトレンド」を知る上で、よくまとまっている2017年の論文"Deep learning in remote sensing: A comprehensive review and list of resources."がありましたので、この論文の解説をします。

1. はじめに

宇宙から地球を観測するリモートセンシング(リモセン)データと深層学習については宙畑でも色々な記事が出ています。この「リモセン×機械学習」を俯瞰でみた時にどのようなトレンドになっているのでしょうか。

この「リモセンと深層学習の課題とトレンド」を知る上で、よくまとまっている2017年の論文“Deep learning in remote sensing: A comprehensive review and list of resources.”がありましたので、この論文の解説をします。なお、本記事は筆者が論文を読んで解釈して要約して執筆いたしましたので、全てを網羅出来ているわけではなく、順序の変更や補足的な内容の追記も行っております。詳しくは元論文をご参照下さい。

2. 本記事の要点まとめ

本記事は1万字を超える記事になりましたので、筆者が考える要点をまとめておきます。詳しくは本記事本文または元論文をご参照ください。

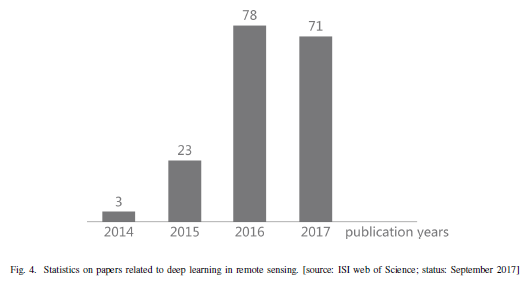

2.1. 「リモセン×機械学習」の研究論文トレンド

深層学習は2012年にトロント大学のヒントン教授らが人工知能コンペLarge Scale Visual Recognition Challenge 2012 (ILSVRC2012)で深層学習を用いて圧勝したことがきっかけで注目されるようになりました。リモートセンシング分野においては論文数が2015年頃から急激に増え始めており、深層学習が注目されていることがわかります。

2.2. 深層学習をリモートセンシングデータに適用する目的

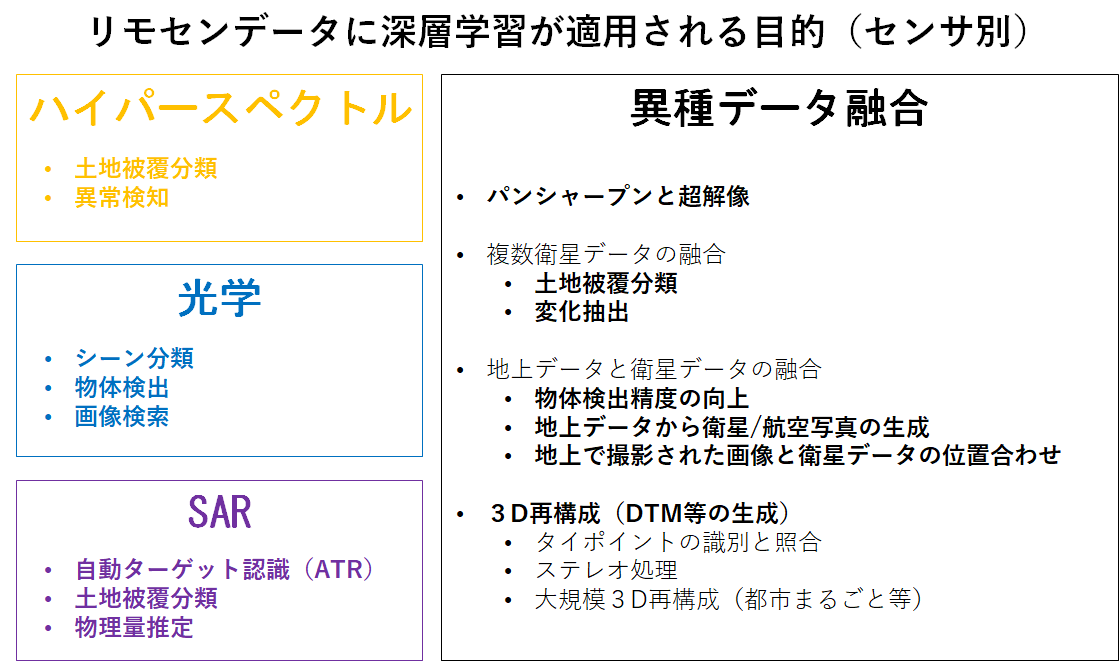

論文中には深層学習をリモセンデータに適用する目的として以下が挙げられています。

衛星センサの種類ごとにも深層学習は適用されていますが、異なる衛星データの融合や地上データと衛星データの融合を図る「異種データの融合」においても、近年深層学習の適用が注目されています。

2.3. 深層学習をリモートセンシングデータに適用する際に考慮すべきこと

深層学習をリモセンデータに適用する際に考慮すべきこととして以下が挙げられています。

- ●マルチモーダルなデータであること

- ●地理空間データとの融合の際には工夫が必要であること

- ●専門知識が必要であること

- ●画像であり時系列データであること

- ●ビッグデータ処理が必要になること

- ●深層学習に対する懐疑的な意見があること

それぞれの項目について、詳細を第3章で解説しております。

2.4. 「リモセン×深層学習」における課題

深層学習をリモセンデータに適用する際の課題として以下の点が指摘されています。

●「リモセン×深層学習」を行う目的として分類や物体検出以外の目的があまりない

●グローバルスケールで深層学習がリモセンデータに適用できるのかわからない

●リモセンデータは学習データが豊富になく、限られたトレーニングサンプルでより”深い”学習が可能かわらない

●リモートセンシングは基本的に物理的なプロセスによって観測されるが物理ベースのモデリングと深層学習の融合はあまり図られていない

●リモセンデータが時系列かつ空間的に特殊であるため、他の分野で成果を出している深層学習モデルが使いにくい(筆者追加)

その上で、筆者からみて何が重要で、今後どのようなことにチャレンジしていきたいのかについて最終章で述べていますので、ぜひご覧いただけますと幸いです。

それでは、宙畑編集部が気になる論文「Deep learning in remote sensing: A comprehensive review and list of resources.」の解説をご覧ください。

3. リモートセンシングデータに深層学習を適用する際に考慮すべきこと

リモセンデータを深層学習手法を適用する際に以下の考慮すべきことが論文中で指摘されています。どれもリモセンデータの特殊性によるもので、リモセンデータを深層学習で扱う際には課題を理解して工夫していくことが必要です。

3.1. マルチモーダルなデータであること

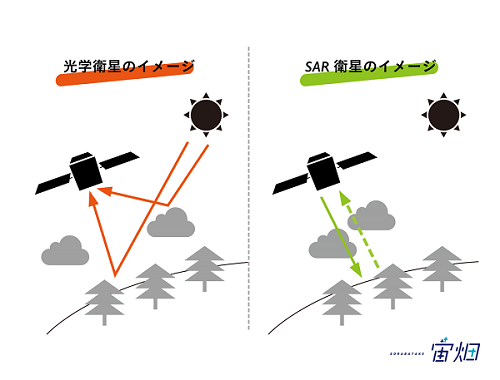

リモセンデータは、衛星に搭載されたセンサごとに異なるマルチモーダル(multimodal)なデータです。例えば衛星に搭載されているセンサには光学センサや合成開口レーダー(SAR)があり、補完しながら使えば観測頻度を上げることができます。しかしながら、この2つでも観測方法が大きく異なりますし、光学やSAR以外にも多くの種類の衛星センサがあります。これらの違いを理解して上手く使わなければいけません。

3.2. 地理空間データとの融合の際には工夫が必要であること

リモセンデータは地理空間データです。リモセンデータの各ピクセルは地理空間座標に対応しています。一方リモセンデータ以外にも地理空間データとしては、ソーシャルメディアからのジオタグ付き画像など様々なデータがありますし、日々新しい種類の地理空間データが出てきています。こうしたリモセンデータ以外のデータとの融合は有用そうですが、例えば画像とポイントデータの融合など、活用するためには工夫が必要になります。

3.3. 専門知識が必要であること

リモセンデータから得られる物理量(単なる画像のピクセル値ではなく物理的に意味のある値のこと。例えば、温度や対象の反射率など。詳しくはこちら)は品質が保証されたデータでもあります。しかしながら、例えば同じ衛星から得られた海面水温でも、「光学センサから得られた海面水温」と「マイクロ波放射計で得られた海面水温」では観測方法が異なるため、誤差要因や精度が異なります。データを使う際にはどのようなセンサでどのようにして得られた物理量なのかというようなセンサ特性と、データ品質に関する専門知識を理解した上で用いる必要があります。

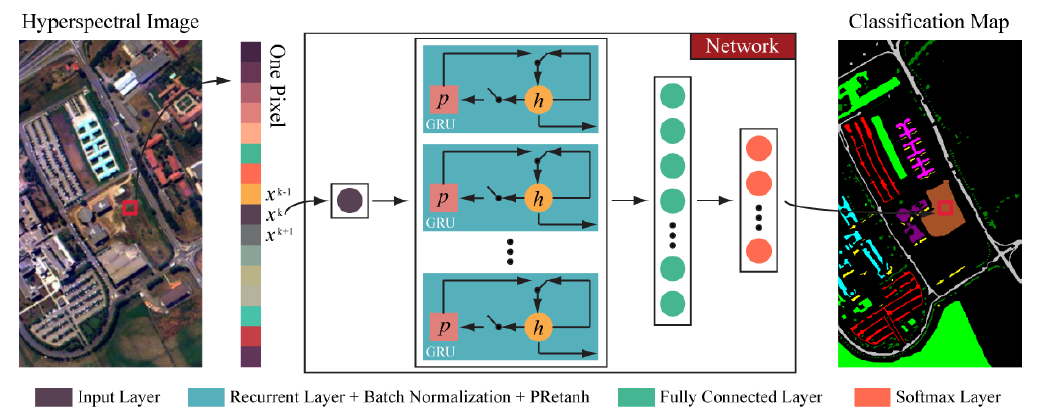

3.4. 画像であり時系列データであること

欧州の人工衛星Sentinel-1は6日ごとに地球全体を観測しているなど、リモセンデータは画像データでありながら観測した日時が刻一刻と変わるため時系列データとしての側面を持っています。つまりリモセンデータを上手く扱うには画像処理だけでなく時系列処理が必要になります。こうしたデータの空間情報と時間情報を最適に活用するためには工夫が必要です。

3.5. ビッグデータ処理が必要になること

リモセンデータはビッグデータです。一枚の画像だけでギガバイト単位のものがありますし、そうしたリモセンデータが日々増えています。例えば欧州の人工衛星Sentinel衛星はすでに約25ペタバイトのデータを取得しています。(2017年当時)こうしたビッグデータを上手く処理する工夫が必要です。

3.6. 深層学習に対する懐疑的な意見があること

リモートセンシングは元々、深層学習でよく用いられるようなオブジェクト検出や分類のためではなく、温度や水蒸気量などの物理量を取得することを目的として観測が行われています。このリモセンデータから得られる物理量の推定には、各分野の専門知識に基づいた各物理量を推定するためのプロセスモデル(計算式)が使われています。データから自動的に学習して物理量を推定するような深層学習に対しては懐疑的な意見があるため、深層学習から得られた結果を新しく捉えなおす必要があります。

宙畑メモ 深層学習モデルについて(一般的な話)

論文中ではオートエンコーダー、畳み込みニューラルネットワーク(CNNs)等の一般的な話が記載されています。本記事では割愛しますが、深層学習にあまり詳しくない方は元論文を読んでみてはいかがでしょうか。

4. 様々な種類のリモセンデータに対する深層学習の活用

ここでは様々な種類のリモセンデータに対して深層学習手法を適用した事例をセンサごとに紹介します。元論文には参考文献を含めて沢山の事例が紹介されていますが、ここではいくつかピックアップして紹介しています。

4.1. 高分解能光学データと深層学習

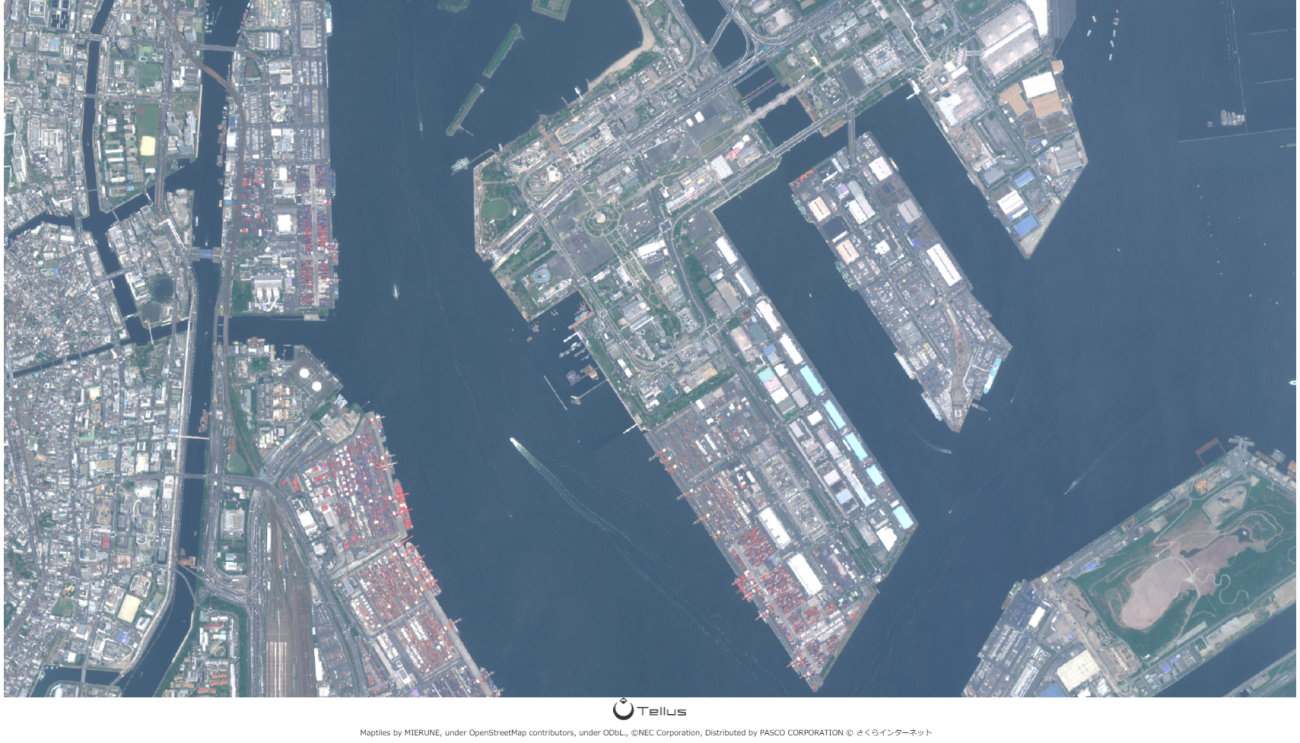

航空写真と同じ様に上空から地表面を観測する高分解能光学衛星のデータは、雲等で地表面が隠れていると地表面を観測出来ませんが、見た目にわかりやすくあまり衛星データに馴染みのない方でもわかりやすいデータです。

深層学習の活用において、高分解能光学衛星データはカメラ画像とも言えるため、リモセン以外の分野で成果を出している深層学習手法を比較的簡単に適用できるデータです。ここではシーン分類、物体検出、画像検索について紹介します。

高分解能光学データと深層学習:シーン分類

高分解能光学データの画像一枚一枚(シーン)に対して「何が写っているか」自動的にラベリングする研究はこれまでも盛んに行われてきました。例えば、画像領域ごとにゴルフ場が写っている画像かどうか判定するようなイメージです。このラベリングを行うことで、オブジェクト検出のほか、変化抽出(同じ場所で地物の数が変わったなど)や都市計画、土地管理に役立てることができます。

このシーン分類の難しい部分は、「同じ様に見えるが異なる地物・エリア」を区別しなければならないところです。例えば住宅エリアと商業エリアでは建物・道路・街路樹がありますが、異なるエリアであるため区別して分類しなければいけません。

このシーン分類は「高分解能光学データから特徴抽出を行う」特徴抽出ステップと「得られた特徴から分類する」分類ステップに分けることができます。深層学習は分類を得意としているので、その両方のステップで活用が期待出来ます。中でもその後の分類結果に影響を与えるため「特徴抽出」ステップは重要です。

最近ではシーン全体を網羅した特徴抽出を行う深層学習を用いた研究が盛んに行われています。深層学習のアプローチとしては、「事前学習済モデルの活用」「事前学習済モデルの再学習・ファインチューニング」「モデルの新規構築」という大きく3つのアプローチで研究されています。

事前学習済みモデルの活用

(衛星データ用ではない)有名なモデル(GoogLeNetなど)に衛星データを入力し、中間層での出力を取り出すことで特徴抽出を行うアプローチです。数千万の画像データを学習済のモデルでは画像の特徴抽出を行う能力が既にありますので、その能力をそのまま活かすことが出来ます。この場合、モデルの構成は変更せずにそのまま用い、新たに衛星データで学習を行いませんので、衛星データ特有の特徴を抽出することは難しい場合があります。

事前学習済みモデルの再学習・ファインチューニング

(衛星データ用ではない)有名なモデル(GoogLeNetなど)に衛星データを再学習させて特徴抽出を行うアプローチです。数千万の画像データを学習済のモデルには画像を特徴抽出を行う能力が既にありますので、こうしたモデルに衛星データを学習させ、衛星データ用に微調整(ファインチューニング)して用いるものです。ただし微調整に用いる衛星データが事前学習に用いたデータ数よりもはるかに少ないため、十分にネットワーク全体を微調整できない問題があります。

モデルの新規構築

ゼロから衛星データ用にモデルを構築するアプローチです。研究が行われている分野ではありますが、上記2つのアプローチに比べて分類精度が低いことが多いです。これは事前学習済のモデルには既に「画像としての特徴」をとらえる能力が十分あることに対して、新しく構築したネットワークには画像の特徴をとらえるところから学習させなければいけません。また(GoogLeNetのような)大規模なモデルを学習させるための十分な画像データセットが用意出来ず、小さなモデルをデータセットごとに学習させることになります。

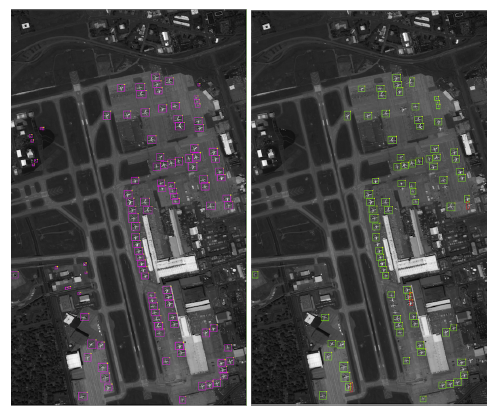

高分解能光学データと深層学習:物体検出

画像上の物体の位置とその種類(人や車など)を検出する物体検出は、深層学習で最も注目されているトピックの一つです。高分解能光学衛星データおいても物体検出は非常に重要なテーマですので、物体検出を非常に得意とする深層学習の活用が注目されています。

「事前学習済みモデルの再学習・ファインチューニング」、もしくは「事前学習済みモデルをベースにモデルを改変する」ことによって高分解能光学衛星データの物体検出を行うことが多いようです。

(左:正解データ、右:深層学習で得られた検出結果)

Credit : "Deep learning in remote sensing: A comprehensive review and list of resources."より抜粋。

高分解能光学データと深層学習:画像検索

例えばゴルフ場が写っている衛星データのみだけ検索して選ぶといった、類似した衛星データを検索して活用するために深層学習が用いられています。一般的な画像検索では画像の特徴抽出を行い、画像の類似度を計算することで実現していますが、この「画像の特徴抽出」がシーン分類同様、画像検索においても重要です。畳み込みニューラルネットワーク(CNN)の中間層の出力を用いて特徴抽出を行うアプローチ等が研究されていますが、高度な画像検索のための特徴抽出はまだ研究段階です。検索システムを使ったユーザーからのフィードバックを活用する方法も注目されています。

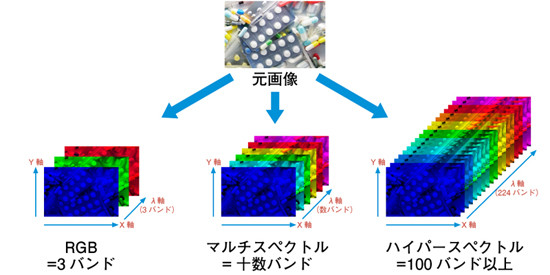

4.2. ハイパースペクトルデータと深層学習

通常の画像は赤・青・緑の波長の光を観測していますが、ハイパースペクトルセンサはその波長をさらに細かく数百に分けて観測を行うセンサです。

波長を細かく分けて捉えることで、対象物の反射特性を詳細に捉えることができるので、住宅域や田畑、森林などを分類する土地被覆分類などに用いられています。

そんなハイパースペクトルへの深層学習の適用が研究されており、ここでは土地被覆/用途分類と異常検出に関する事例を紹介します。

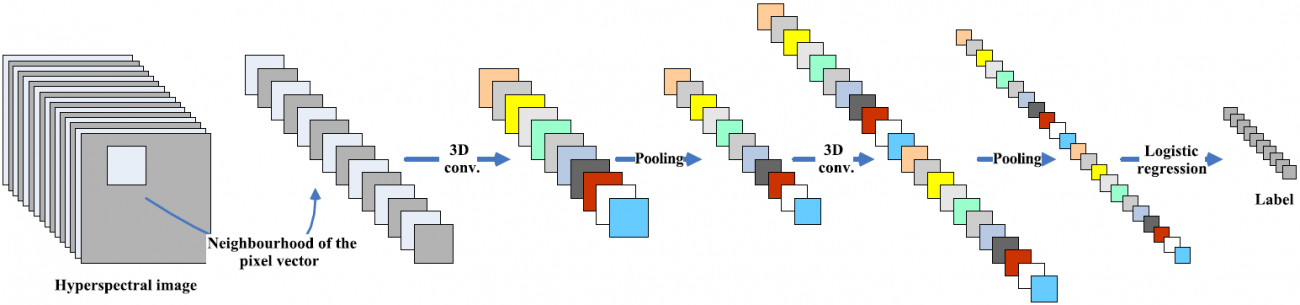

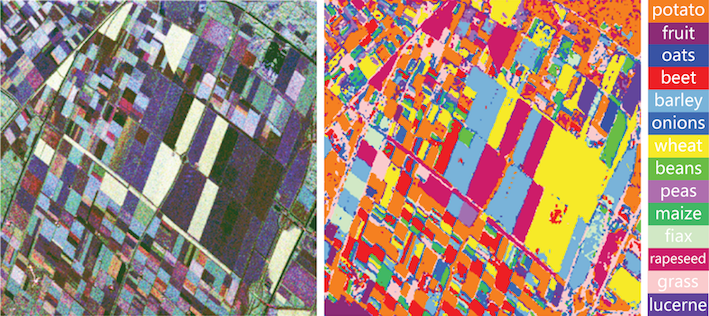

ハイパースペクトルと深層学習:土地被覆分類

深層学習が注目される以前からハイパースペクトルデータを使った土地被覆分類は決定木、ランダムフォレスト、サポートベクターマシン(SVM)などの教師あり機械学習モデルで行われてきました。

こうした先行研究からハイパースペクトルセンサは以下のような理由で、分類が難しいことがわかってきました。

- ●大気散乱条件を考慮する必要がある:波長ごとに大気を通過する際の散乱条件が異なる

- ●複雑な散乱メカニズムを考慮する必要がある:大気の状態によって電磁波の散乱過程が異なる

- ●クラス間類似性が高い:特徴空間の中でクラス間の特徴が似通っていて分類が難しい

- ●クラス内変動性が大きい:同一クラス内の特徴空間内の特徴の分散が大きく分類が難しい

深層学習はこうしたハイパースペクトルデータに対してより観測環境変化に強く高度な分類が可能になると考えられており、深層学習の適用が進んでいます。

ハイパースペクトルと深層学習:異常検知

ハイパースペクトルデータにおいて通常と異なるスペクトルが観測された場合、異常を検知することが出来ます。通常、異常なデータが得られるのは稀で、データを事前に取得することは難しいので、異常検出はハイパースペクトルデータのバックグラウンド(普通の状態)モデリングや統計な評価で従来行われてきました。

異常検知は深層学習の得意とするテーマですが、ハイパースペクトルデータ用いた異常検知はあまり盛んに行われていません。論文では“Transferred deep learning for anomaly detection in hyperspectral imagery(2017)” という論文のみ紹介されています。この研究では深層学習を用いた異常検出フレームワークを提案しており、多層CNNを用いています。

4.3. 合成開口レーダー(SAR)データと深層学習

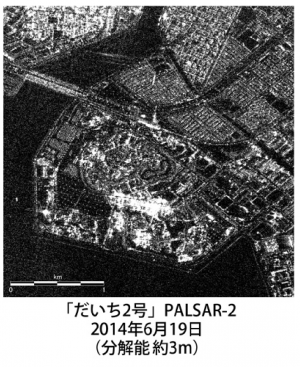

合成開口レーダー(SAR)は衛星からマイクロ波を照射して、その反射を観測するセンサです。マイクロ波は雲を透過するため、通常の光学観測では観測できない曇りの日や夜でも観測することができます。

SARデータはマイクロ波の跳ね返りを見ているため、通常の画像のようにカラーにはならず、妊婦さんのエコーの画像のような白黒でざらざらとしたデータになります。

SARデータに対して深層学習を適用した研究は多く報告されています。論文では自動ターゲット認識(Automatic Target Recognition, ATR)、土地被覆分類、物理量推定を目的として深層学習を用いた例が紹介されています。

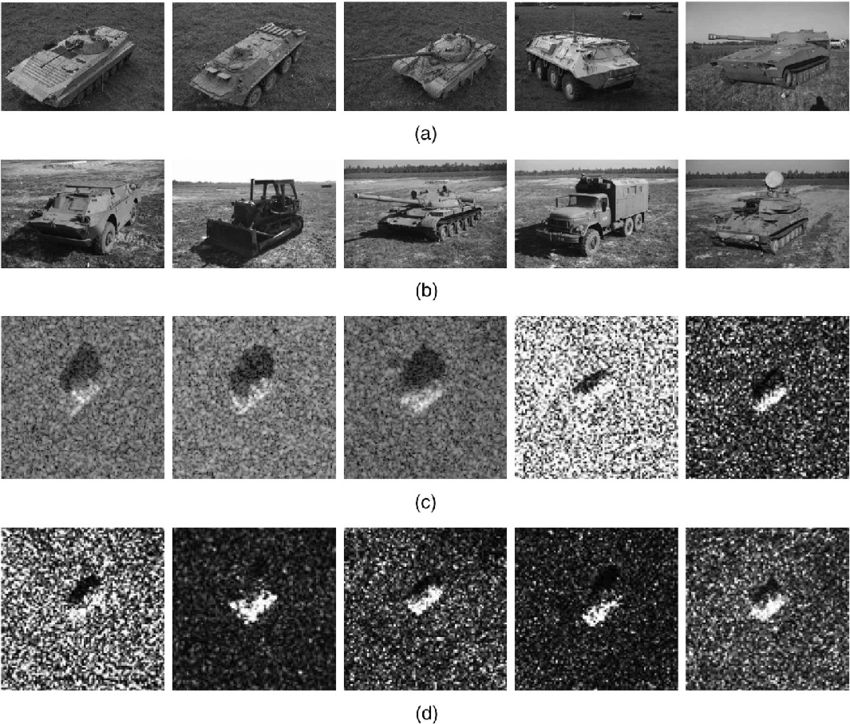

SARと深層学習:自動ターゲット認識(ATR)

自動ターゲット認識(ATR)は文字通りSARデータから船や飛行機等の地物ターゲットを認識することが目的です。ATRは軍事的にも重要な目的で、これまで多くの研究がなされてきました。

ATRには「検出(detection)」「識別(discrimination)」「分類(classification)」3つの認識段階があります。認識段階は検出から分類へと段階を経るごとにより高度な認識になりますが、全て分類問題ですので、分類問題を得意とする深層学習が注目されています。

SARのATRデータセットとしてはMSTARというデータセットが知られていますが、光学データに比べるとデータセットが豊富にあるわけではありません。データセットが少ないことは深層学習モデルが過学習を起こしやすくなり、汎化性能(未知のテストデータに対する識別能力)が上がりません。少ないデータで汎化性能を上げるため、モデルそのものを工夫することや、データの水増し(Augmantation)によって汎化性能を上げる研究が行われています。

SARと深層学習:土地被覆分類

SARデータを使ってで土地被覆分類を行う研究は従来から行われてきました。この土地被覆分類は深層学習の所謂「セグメンテーション」とよく似ており、深層学習の活用が期待されています。

深層学習以前のSARデータの土地被覆分類はピクセル単位のパターンに注目して分類する方法で、空間的な特徴はあまり活用されていませんでした。深層学習を用いることで、空間的な特徴を土地被覆分類に活かすことが出来ます。

(左:PolSARカラー画像、右:土地被覆分類結果) Source : "Deep learning in remote sensing: A comprehensive review and list of resources."より抜粋。

SARと深層学習:物理量推定

深層学習を用いて物理量を推定する研究です。論文の中ではSAR画像を使用して海氷密接度(ある氷域の中の氷の分布状態がばらばらになっているか、つまっているか、その平均の密集程度を10分位法で表したもの。参考:海上保安庁HP)を推定する例が挙げられています。

5. マルチモーダルデータ融合

異なる衛星データの組み合わせて活用することや、衛星データと衛星データ以外のデータを組み合わせて活用することはリモートセンシングにおいても注目されているテーマです。そして深層学習はこのマルチモーダルデータ融合においても活用が期待されています。ここでは「パンシャープンと超解像」「複数の衛星データの融合」「異種データとの融合」について紹介します。

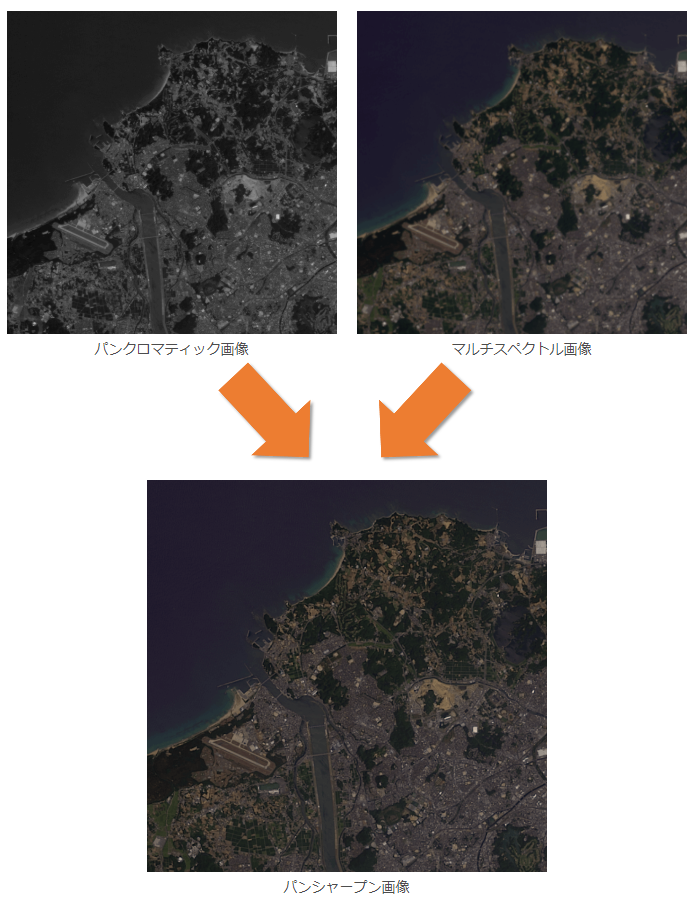

パンシャープンと超解像

光学衛星データにはパンクロマティックデータとマルチスペクトルデータの 2 つがあります。

パンクロマティックデータはより幅広い波長を観測し、高分解能なデータを取得することができますがモノクロの画像データになります。

一方、マルチスペクトルデータは、可視光から近赤外線まで複数の波長帯の電磁波を記録しているため多くのスペクトル情報を持っておりカラー画像として可視化することも可能ですがパンクロマティックデータよりも低解像度になります。

この 2 つの画像を合成することで、高解像度のマルチスペクトル画像を作成することができます。この得られた画像のことをパンシャープン画像といいます。(参考:ESRIジャパンHP)

このパンシャープン処理により、例えばマルチスペクトルデータよりも高分解能なカラー画像が得られるので、画像の解像度(空間分解能)を上げる、いわゆる「超解像」として考えることもできます。

従来、パンシャープン処理は上述の光学衛星データのマルチスペクトルデータとパンクロマティックデータを融合する作業が主流でしたが、最近では、熱赤外データやハイパースペクトルデータ等の他のセンサデータへも拡張されています。

従来の光学衛星データのパンシャープン処理だけでなく他のセンサデータへのパンシャープン処理に対して深層学習手法を使うことが注目されています。注目されている理由には深層学習の有用性だけでなく深層学習を適用するにあたってデータが十分にあるという適用環境の良さもあります。例えばWorldViewシリーズまたはLandsatという衛星によって取得されたほとんどの画像にはパンクロマティックバンドが付属しているため、トレーニングデータが豊富で深層学習を適用しやすい環境があります。

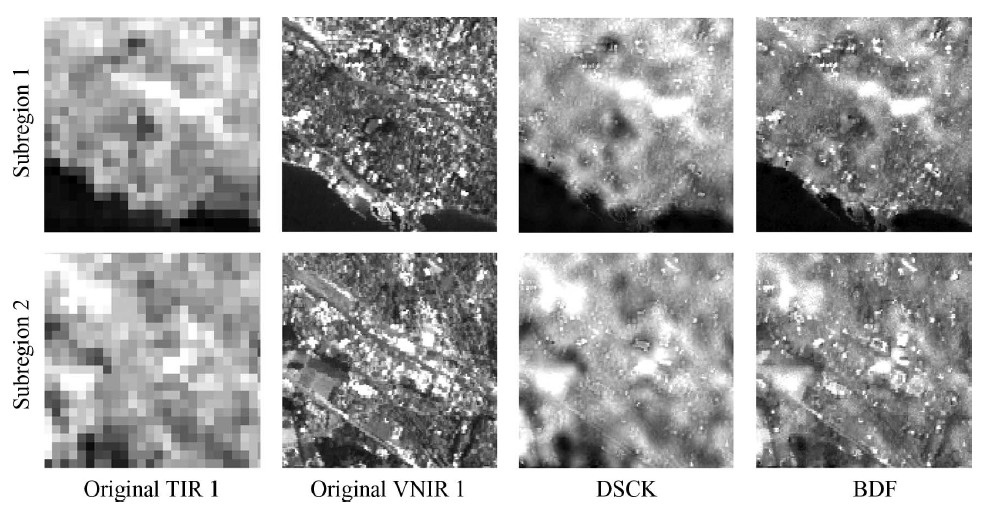

VNIR1。その隣からパンシャープン画像でDSCK(クリギングによる空間補間)によるパンシャープン画像、深層学習を用いたBayesian data fusion (BDF)手法によるパンシャープン画像。BDFのほうがDSCKによるパンシャープンよりも綺麗に見える。 Source : “Support-Based Implementation of Bayesian Data Fusion for Spatial Enhancement: Applications to ASTER Thermal Images”より

複数種類の衛星データの融合

複数種類の衛星データを融合して用いる研究は従来行われてきましたが、深層学習を用いた研究分野としても注目されています。

複数種類データを直接深層学習モデルに入力

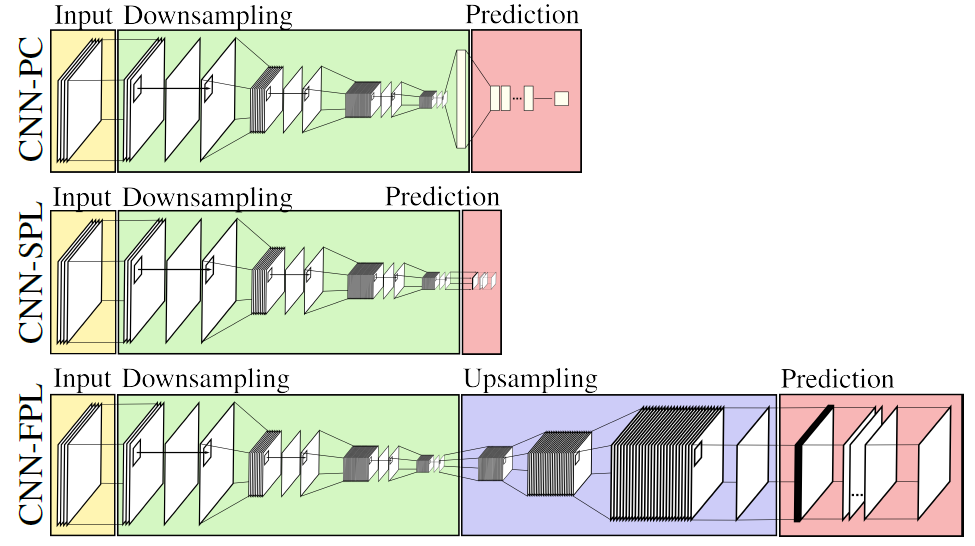

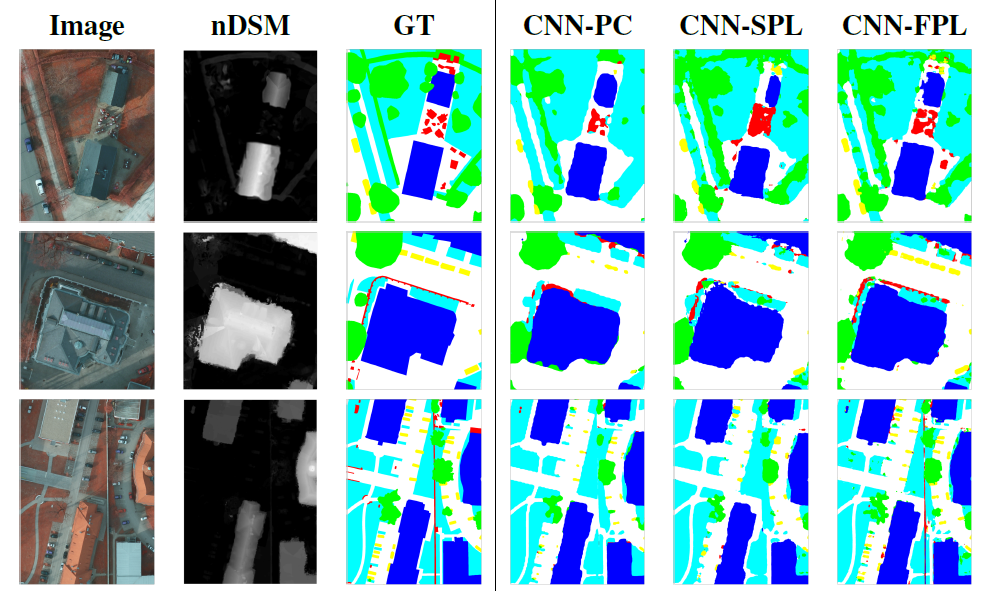

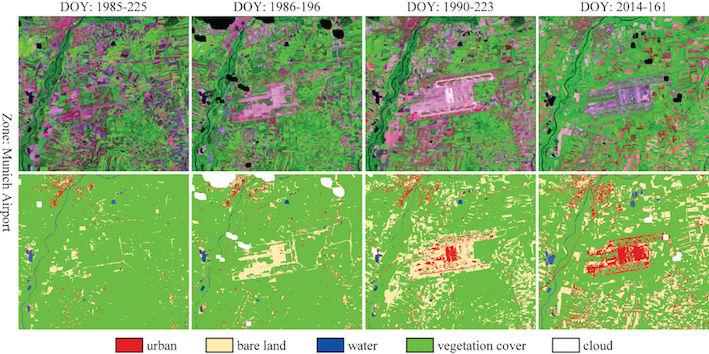

深層学習モデルに複数種類のデータを多次元のリモセンデータ(データキューブ)として入力するアプローチです。ここでは土地被覆分類(セグメンテーション)を紹介します。

アプローチとしては

- ●検索窓(予め設定した画像上の小領域)を画像上で走査しCNN等で特徴抽出を行った後、CNNの出力層の全結合層やSVM(support vector machine)等で検索窓中央のピクセル値のセグメンテーションを行う方法

- ●CNNで特徴抽出した後、逆畳み込み(デコンボリューション)アップサンプリングによりセグメンテーション結果を得る手法

があります。

複数種類データを前処理してから深層学習モデルに入力

複数種類のデータを深層学習モデルに入力する際に、多次元のリモセンデータ(データキューブ)としてモデルに入力するのではなく、画像フィルタ等による前処理を行ってから深層学習モデルに入力する方法が研究されています。これにより”深い”モデルでなくても高度なセグメンテーションが可能になります。

複数種類データによる変化抽出

複数種類のデータを活用することで、変化抽出を行うことができますが、異なるデータを比較することになります。例えば観測日の異なる光学衛星データとSARデータを比較して変化抽出する際には、直接差分をとって比較することはデータの種類が異なるため難しいです。比較の際には光学衛星データは光学衛星データで、SARデータはSARデータで特徴抽出をして、同じ指標にしてから変化抽出を行うことになります。つまり比較のために衛星データから特徴抽出を行えれば異なる種類の衛星データを使った変化抽出が可能になります。論文中では以下の3例が紹介されています。

- ●比較対象の2つの画像それぞれでDBN(Deep Belief Network)による特徴抽出を行い、その差分で評価する研究(論文中ではGaoFen-1衛星とWorldView-2衛星に適用):“Superpixel-based difference representation learning for change detection in multispectral remote sensing images,”

- ●比較対象の2つの画像それぞれでオートエンコーダ(のエンコード部分)による特徴抽出を行い、その差分で評価する研究(論文中では光学画像とSAR画像のペアの複数のデータセットに適用):“Change detection based on deep feature representation and mapping transformation for multi-spatial-resolution remote sensing images,”

- ●比較対象の2つの画像それぞれでRNNによる特徴抽出を行い、その差分で評価する研究。上記2つの手法との違いは時系列データとしてデータを入力することにより時系列的な情報を活用する点です。(論文中では光学画像とSAR画像のペアの複数のデータセットに適用):“A deep information based transfer learning method to detect annual urban dynamics of four developed cities from 1984-2016 by Landsat data,”

複数種類データを複数の深層学習モデルに入力

データごとに複数の深層学習モデルを学習し、出力層に近い中間層(全結合層)でモデルを融合するアプローチが研究されています。

例えば光学衛星データにはVGG等の有名なモデルを、DEM等の既存のモデルでは再学習しづらいデータは新たに別のネットワークを用意して、これら異なる別々のモデルを出力層付近で結合して学習させるということです。これにより空間分解能の異なる衛星データを融合して使える可能性があります。

地上データとリモセンデータの融合

衛星データ間のデータ融合だけでなく、衛星データ以外のデータ融合にも深層学習を適用する研究が行われています。衛星データだけでなく地上データも増えてきており、最も注目されている研究分野です。

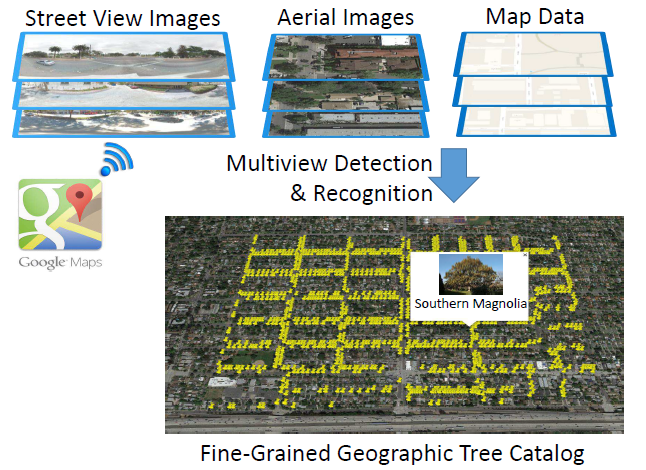

GoogleストリートビューやFlickrなどのサービスは、主観視点の地上で撮影された画像が提供されています。この画像を融合して、リモセンデータのような俯瞰図を生成する研究が行われています。この生成された俯瞰図によりオブジェクト検出精度等を向上させることが期待されています。

例えば“Cataloging Public Objects Using Aerial and Street-Level Images – Urban Trees”ではリモセンデータ上の樹木検出と樹種分類精度を地上データを融合することで向上させています。まず航空写真とGoogleストリートビューのパノラマで樹木をFaster R-CNN等で検出した後、それらの結果を融合して検出精度を高めています。さらにGoogleNetをベースに、樹木検出結果に対して樹種分類を実行し分類しています。この検出精度と分類精度は人間に匹敵するレベルであったとのこと。

別の例では、

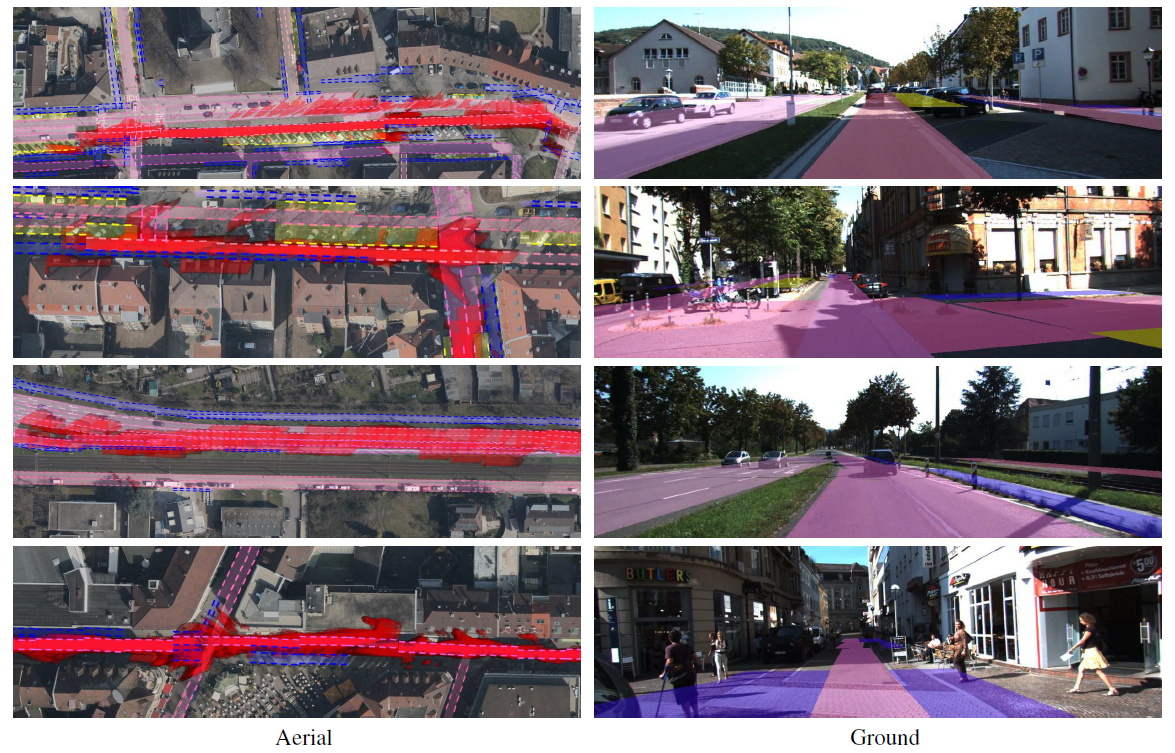

- ●地上で撮影された写真をリモセンデータ上のどこで撮影されたか判定する研究(“Hd maps: Fine-grained road segmentation by parsing ground and aerial images”)

- ●地上で撮影された写真とリモセンデータ間の変化を検出するため、地上で撮影された写真を航空写真の様に加工する研究(”Towards seamless multi-view scene analysis from satellite to street-level”)

等が紹介されています。

右:地上で撮影された画像に左画像上で位置合わせを行い道路・歩道を投影した例。 Source : “Hd maps: Fine-grained road segmentation by parsing ground and aerial images”より抜粋。

6. 3D再構成

数値標高モデル(DEM:Digital Elevation Model)等の3Dデータがリモセンデータを使って生成されてきました。これらの3Dデータはインフラの敷設や都市計画においても重要です。

一般的な3Dデータ生成にあたっては、2枚以上の異なる角度で観測されたリモセンデータを準備し、「カメラの位置と向きの計算」「ステレオマッチングによる3D推定」の2つ処理を行います。これまで機械学習は「ステレオマッチングによる3D推定」処理の中であまり用いられてきませんでしたが、機械学習技術を使用して大幅に精度を改善することが期待されています。

タイポイントの識別と照合

タイポイントは2枚以上のリモセンデータでほぼ同じ場所を観測した際に対応する同じ場所をマークしたポイントのことです。ステレオマッチングにあたってはタイポイントの識別と照合を行う必要があります。昔は、このタイポイントの生成は手動で行ってきましたが、画像処理のSIFTやSURF特徴量を用いることで自動化されてきました。しかし人間ほど正確にタイポイントをとることができていませんでした。このタイポイントの生成に深層学習を用いて、より正確なタイポイントを生成することが期待されており、研究が行われています。

ステレオ処理

3Dデータの生成にはステレオマッチング処理を行って3D推定を行います。このステレオマッチングにはsemi-global matching (SGM)等が標準的に用いられてきましたが、推定精度に課題がありました。近年ではこのステレオ処理に深層学習が用いられています。

都市レベルの大規模処理

従来の3Dデータ生成プロセスでは、画像上のオブジェクトとしての情報が無視され、幾何的に生成されていました。つまり3Dデータ生成に用いる画像データは、意味的な(純粋な)強度値として扱われきていました。深層学習を適用することにより、より精度の高い3Dデータが生成することができるだけでなく、画像分類を行うことで3Dデータに直接分類結果(植生、道路、建物など)を紐付ける事が可能になってきています。こうした処理を行うことで都市レベルの3Dデータ生成が可能になります。

7. リモセンデータと深層学習の民主化

論文中ではこれからリモートセンシングで深層学習に取り組みたい人向けに以下のものが紹介されています。

●チュートリアルのリスト

●オープンソースのディープラーニングフレームワーク

●オープンリモートセンシングデータリスト

○シーン分類

■UC Merced dataset

■AID dataset

■NWPU-RESISC45 dataset

〇セグメンテーション

■Zurich Summer Dataset

■Zeebruges, or the Data Fusion Contest 2015 dataset

○SARと光学データのマッチング

■SARptical Dataset

●学習済ソースコード例

■Deconvolution network in MatConvNet

■Fully convolutional (SegNet) architecture in Caffe

■AConvNet for SAR ATR in Caffe

■Residual Conv-Deconv Network in TensorFlow

8. 「リモセン×深層学習」における課題と筆者所感

深層学習をリモセンデータに適用する際の課題として以下の点が指摘されています。

- ●「リモセン×深層学習」を行う目的として分類や物体検出以外あまりない

- ●グローバルスケールで深層学習がリモセンデータに適用できるのかわからない

- ●リモセンデータは学習データが豊富になく、限られたトレーニングサンプルでより”深い”学習が可能かわらない

- ●リモートセンシングは基本的に物理的なプロセスによって観測されるが物理ベースのモデリングと深層学習の融合はあまり図られていない

論文を読んでみて、深層学習がセンサ毎でなく多様なセンサ間の融合にも用いられるようになってきており、深層学習の可能性を改めて感じました。一方で、筆者としては上記に追加して以下の課題があるように思いました。

- ●リモセンデータが時系列かつ空間的で特殊であるため、他の分野で成果を出している深層学習モデルが使いにくい(新たな深層学習モデルを構築すべきだが、データが少ないので十分に学習出来ない)

これらの課題の中で、深層学習はデータがなければ学習が難しいので、「データセットが豊富にないこと」は特に重要な課題であると感じています。データセット作成はコストがかかりますので、深層学習による効果などを踏まえた「目的」に沿ってデータセットが準備されるべきです。筆者としては、この「何のために」という目的が重要だと考えています。他の分野で成功した深層学習手法を他の分野と同じ目的(分類や物体検出)で適用すれば上手くいくでしょうし、本論文にある通りこれまでのトレンドとしてそのことがリモセン分野の研究で確認されてきたのだと思います。

これから先、よりリモセンデータに対して深層学習を活用するためには、「リモセン×深層学習」独自の目的を考えて研究していく必要があるように思います。論文からはあまり進んでいない印象を受けましたが物理量推定はリモセン独自の良い目的だと思いますし、その他にも「リモセンならではの深層学習を適用する目的」を考えていくべきだと思います。こういったリモセンへの深層学習のローカライズこそチャレンジしていくべきテーマだと感じました。私としても引き続き挑戦していきたいと思います。