【論文解説】リモートセンシングにおける深層学習のトレンドと過去論文との比較

2019年に発表された「Deep learning in remote sensing applications: A meta-analysis and review」という論文について、2017年の同様の論文との比較と合わせて紹介します。

「論文解説:リモートセンシングにおける深層学習のトレンド」という記事では、深層学習をリモートセンシングに適用することで、何が出来るのかといった概観をつかんでいただけるような内容を紹介しました。

一方で、前回の記事で解説した論文は2017年のもので、既に3年ほど経過しています。

そこで、今回はできる限り最新の情報が載っていて、網羅的な論文と考えられる2019年に発表された「Deep learning in remote sensing applications: A meta-analysis and review」という論文を解説します。合わせて、2017年の論文解説との比較も紹介します。

※基本的にはトレンドを俯瞰的につかむことに重点をおいて執筆しておりますが、本文中でいくつか研究を紹介しています。本文で全て紹介できないほど元の論文では沢山の論文が紹介されていますので、技術的なトレンドの詳細や深層学習の適用事例にご興味がありましたら是非元論文をご参照ください。

(1)論文の統計分析による研究動向

それでは、論文「Deep learning in remote sensing applications: A meta-analysis and review」の解説にさっそく入ります。

論文では、深層学習を利用したリモートセンシングの動向を調査するため、論文数とその内容について論文データベースScopusで「deep learning」と「remote sensing」でタイトル/要約/キーワードに対しAND検索を行っています(論文の検索日:2018年6月2日)。検索した結果、レビュー論文を除くと、221件の査読論文と181件の会議論文の計402件の論文が得られたとのこと。

深層学習をリモートセンシングに適用した研究の発表場所

上述の検索結果から、深層学習をリモートセンシングに適用した研究の発表会議と投稿先ジャーナルがどこであったのか整理されています。

深層学習をリモートセンシングに適用した研究発表先の会議等

(Deep learning in remote sensing applications: A meta-analysis and reviewより抜粋)

深層学習をリモートセンシングに適用した研究発表先のジャーナル

(Deep learning in remote sensing applications: A meta-analysis and reviewより抜粋)

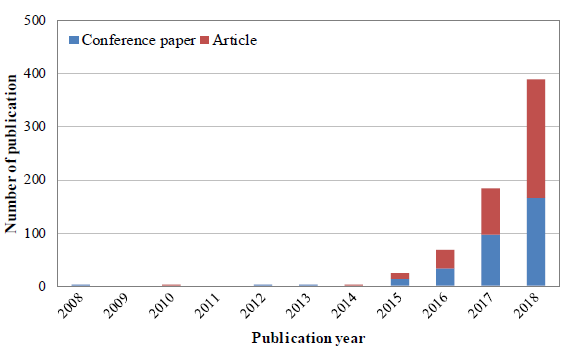

論文数を査読論文(Article)と会議発表(Conferense Paper)で分けてグラフにすると以下になります。

Conferense Paper:会議論文、Article:査読論文 Source : (Deep learning in remote sensing applications: A meta-analysis and reviewより)

査読論文に対して、会議論文は査読プロセスがないため速報性が高くなります。2014年から2016年まではIGARSSやProceedings of SPIE-The International Society for Optical Engineeringの会議で多く研究が報告されていますが、2018年になると査読論文数が会議論文数を上回っており、深層学習をリモートセンシングに適用する研究の成熟度が高まっていることがわかります。

深層学習を活用したリモートセンシングの研究対象

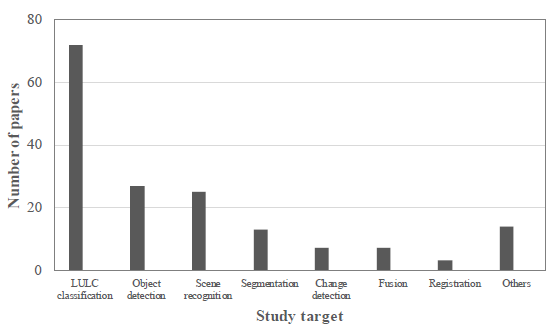

同じく検索した結果から、論文が何を対象とした論文であったか論文数をグラフにしたものが以下です。

グラフから深層学習が適用されている研究としては「土地被覆・利用(LULC, Land Use and Land Cover)分類」、「オブジェクト検出」、「シーン分類」に重点が置かれています。一方で「セグメンテーション」、「変化抽出」、「データフュージョン」等はまだあまり適用されていない様です。

適用されている深層学習モデルの種類

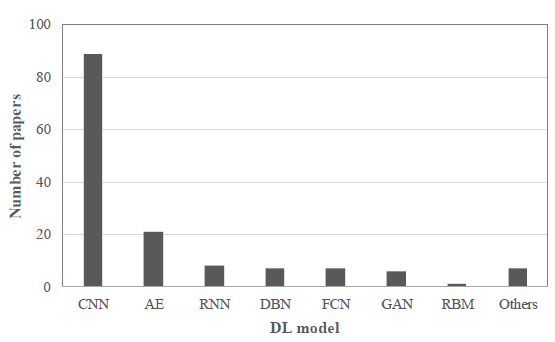

同じく検索した結果から、適用されている深層学習モデルの種類ごとに論文数を調査したものが以下です。

リモートセンシングデータはピクセルが規則的に配置されており、なおかつマルチバンドであるため「CNN(Convolutional Neural Network)」が最も使用されており、次に「AE(Autoencoder)」「RNN(Recurrent Neural Network)」、「DBN(Deep Belief Network)」、および「GAN(Genera tive Adversarial Network)」、「RBM(Restricted Boltzmann Machine)」と続きます。

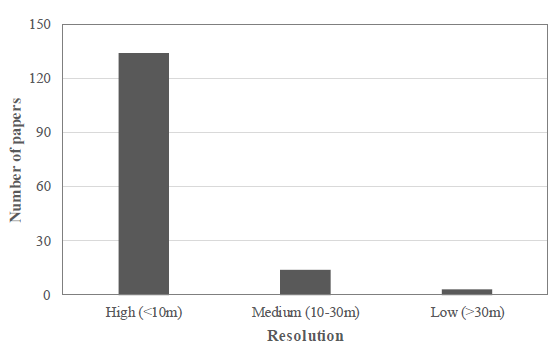

利用されているリモートセンシングデータの空間分解能

同じく抽出した結果から、利用されているリモートセンシングデータの空間分解能ごとに論文数を調査したものが以下です。

深層学習モデルは、10 m以下の空間分解能のリモートセンシングデータ(「High」区分)に非常に多く適用されています。論文によると「High」区分の中でも100件以上研究で用いられたリモートセンシングデータの空間分解能は2 mより細かいものでした。中低分解能(Medium/Low)データよりも高分解能データの方が豊富な空間的特徴情報が含まれているため、深層学習を適用する際に有用であるためです。そして論文数からも深層学習モデルが高分解能データから高レベルの特徴情報を抽出するのに非常に成功していることがグラフから推察できます。

適用フィールド

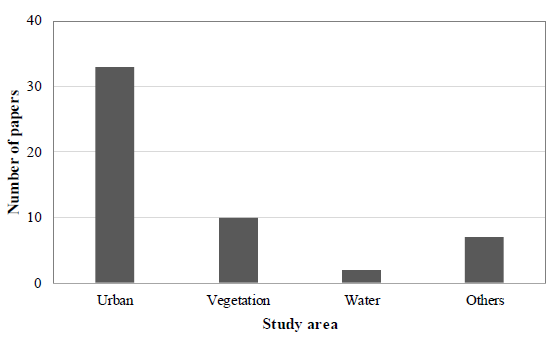

同じく抽出した結果から、深層学習が適用されているフィールドごとに論文数を調査したものが以下です。

このグラフでは「都市地域(Urban)」「植生地域(Vegetation)」「水域(Water)」で大別しています。グラフからほとんどの研究は「都市地域(Urban)」に関するものであることがわかります。

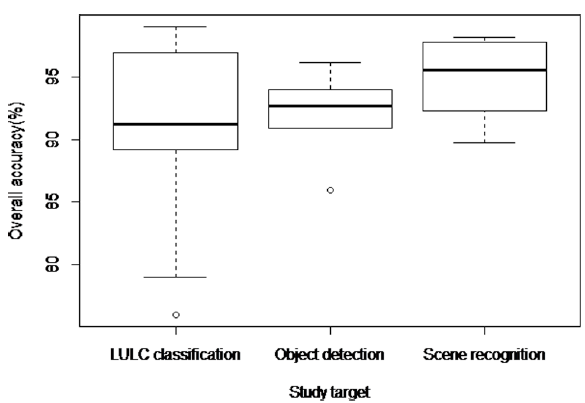

研究対象別の精度

論文では同じく抽出した結果から、3つの研究対象「土地被覆・利用(LULC)分類」「オブジェクト検出」「シーン分類」における深層学習適用時の精度を調査しています。

グラフから、「シーン分類」は高い分類精度(〜95%)の中央値を持ち、「オブジェクト検出」は2番目に高い分類精度(〜92%)、「LULC分類」は分類精度(〜91%)であることがわかります。ただし、これらの研究の多くに深層学習向けに作成されたベンチマークデータセットが用いられており、結果的に比較的高い精度が出ている可能性があります。また「LULC分類」の精度は、用いるデータ、分類クラスの数、およびクラス間の空間スペクトルに比較的大きく依存していることにも注意が必要です。

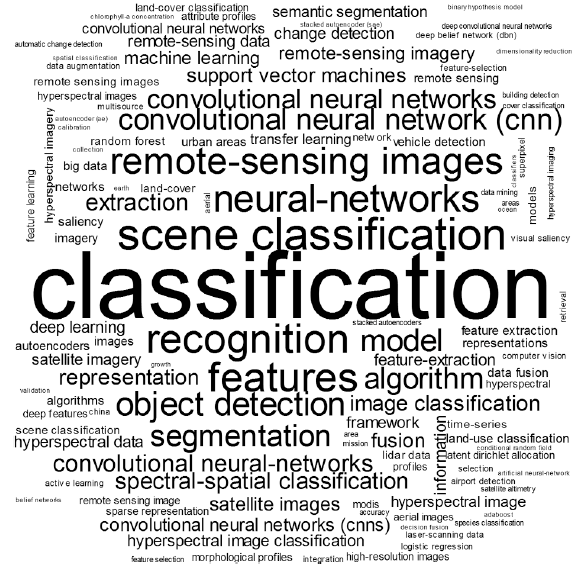

(2)「リモートセンシング×深層学習」におけるキーワード

同じく抽出した結果から、論文のタイトルと要約を分析して、「リモートセンシング×深層学習」でよく用いられるキーワードをタグクラウドとして示したものが以下です。

(頻出キーワードほど文字が大きく表示されている) Source : (Deep learning in remote sensing applications: A meta-analysis and reviewより)

タグクラウドから「CNN(Convolutional Neural Network)」は他の深層学習モデルよりも人気があることがここでも確認できます。

また、画像の「スペクトル空間(spectral-spatial)」特徴も分析に利用されているようです。前述と同様に、研究のキーワードとして多いものは「分類タスク(LULC分類、オブジェクト検出、シーン分類)」ですが、「画像融合(fusion)」、「セグメンテーション(segmentation)」、「変化抽出(change detection)」、「レジストレーション(registration)」なども比較的大きな文字で確認出来、注目度が高いと思われます。

(3)「リモートセンシング×深層学習」でよく用いられるキーワード毎の動向

前項のタグクラウドから、いくつかのキーワードが出てきました。本章では各キーワードの動向について解説します。

画像融合

異なる特性をもつリモートセンシングデータを組み合わせて、新たなリモートセンシングデータを生成するのが「画像融合」です。リモートセンシング分野以外言うところの所謂「超解像」とも言われる技術ともみなすことが出来ます。

低解像度マルチスペクトル(MS)画像と高解像度パンクロマティック(PAN)画像の融合(パンシャープン)

リモートセンシング画像融合の例として、「パンシャープン」が知られています。これは、「低解像度マルチスペクトル(MS)画像」と「高解像度パンクロマティック(PAN)画像」を融合して「高解像度MS画像」を実現するものです。

パンシャープンにはSAE(Stacked Autoencorder)やCNNが用いられています。

特にCNNが注目されており(タグクラウド等の結果とも一致します)、CNNベースのシンプルな研究(Pansharpening by Convolutional Neural Networks)ものから、11の畳み込み層を持つような深いネットワークモデル(Boosting the Accuracy of Multispectral Image Pansharpening by Learning a Deep Residual Network)、PAN用とMS用に別のモデルを生成し融合させるような研究(A Multiscale and Multidepth Convolutional Neural Network for Remote Sensing Imagery Pan-Sharpening)等が行われています。

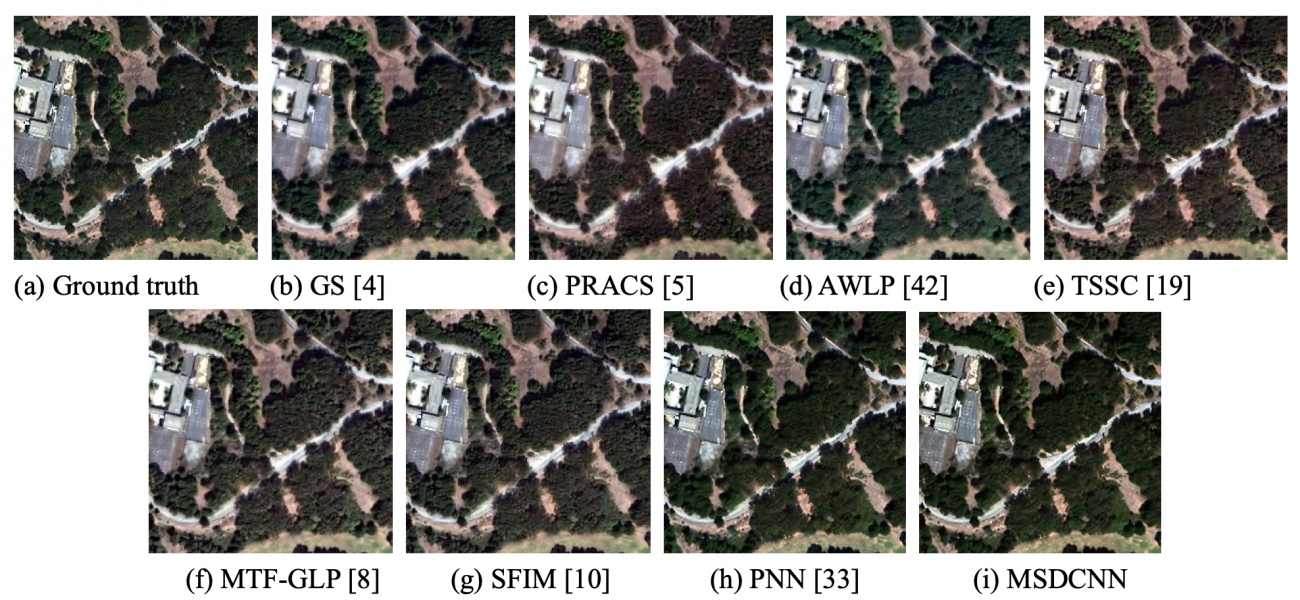

a)が正解データ、(i)が論文が提案しているCNN手法。

(b)〜(h)はその他の手法によるパンシャープン結果。 Credit : (A Multiscale and Multidepth Convolutional Neural Network for Remote Sensing Imagery Pan-Sharpeningより)

高解像度パンクロマティック(PAN)と低解像度ハイパースペクトル(HS)画像の融合

「高解像度パンクロマティック(PAN)画像」と「低解像度ハイパースペクトル(HS)画像」を融合して、「PAN画像」や「高解像度マルチスペクトル(MS)画像」等を生成する研究が行われています。論文では例えば3D-CNNによるHSおよびPAN画像融合方法が紹介されています(Multispectral and Hyperspectral Image Fusion Using a 3-D-Convolutional Neural Network)。

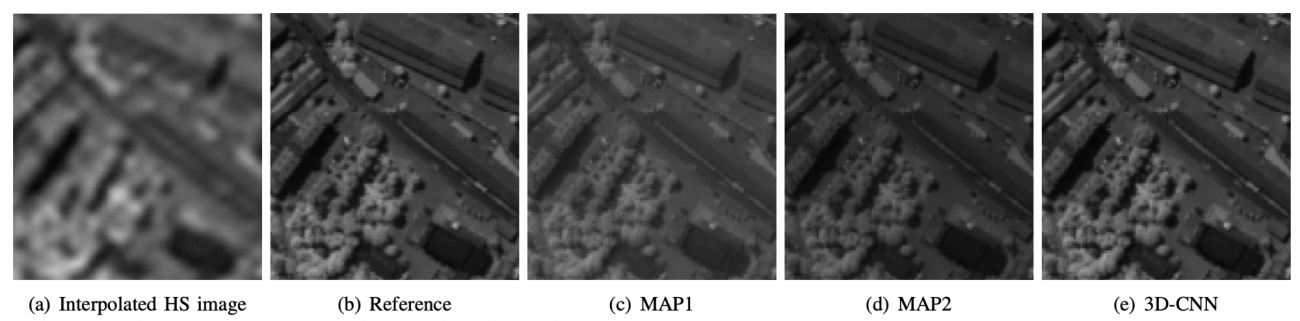

(a)は単純な処理で生成したHS画像、(b)は正解データ

(e)は論文が提案している3D-CNN手法による結果、(c)(d)はその他の手法による融合結果 Source : (Multispectral and Hyperspectral Image Fusion Using a 3-D-Convolutional Neural Networkより)

レジストレーション

レジストレーションは、異なるセンサーが異なる時間に、または異なる視点から観測した2つ以上の画像を位置合わせすることです。これは他の分析を行う前処理として行われています(例えばレジストレーションは画像融合や変化抽出の前に行われます)。

この深層学習を使用したレジストレーションには、取り出した特徴から特徴間の類似度を評価するSiamese network手法が多く用いられていますが、最近ではGANが利用されています(Exploring the Potential of Conditional Adversarial Networks for Optical and SAR Image Matching)。

こうした深層学習によるリモートセンシングデータのレジストレーションは、近年注目されている研究ですが、公開されているトレーニングデータセットが少なく、学習データを手動で作成する必要があります。リモートセンシングデータの多様性(異なる解像度、異なる時間に観測されているなど)を考えると、トレーニングデータを整備することは非常に大変です。

シーン分類とオブジェクト検出

「シーン分類」と「オブジェクト検出」は混同されがちですが別物です。「シーン分類」は、農業画像や森林画像などの多数の画像から、それ自体のカテゴリを決定するものです。一方、「オブジェクト検出」は、単一の画像の上でオブジェクト(たとえば、飛行機、車など)を検出することを目的としています。

シーン分類

深層学習を用いてシーン分類を行う研究は盛んに行われています。多くの研究ではベンチマークデータセット(RSSCN7、UC-Merced、WHU-RSなど)が用いられてきました。しかしベンチマークデータを用いた研究が多く、実際に適用された事例があまりなく、シーン分類を実際の環境で行うには、様々な課題が出てきますので、最近ではこの課題に対応する様な研究が行われています。例えば、実際の観測画像に適用する際にはベンチマークデータほどデータは入手出来ないため、データの水増し(Augmentation)を行う事や、学習効率を上げるための転移学習、学習に必要なデータを減らす半教師付き学習等の研究が行われています。

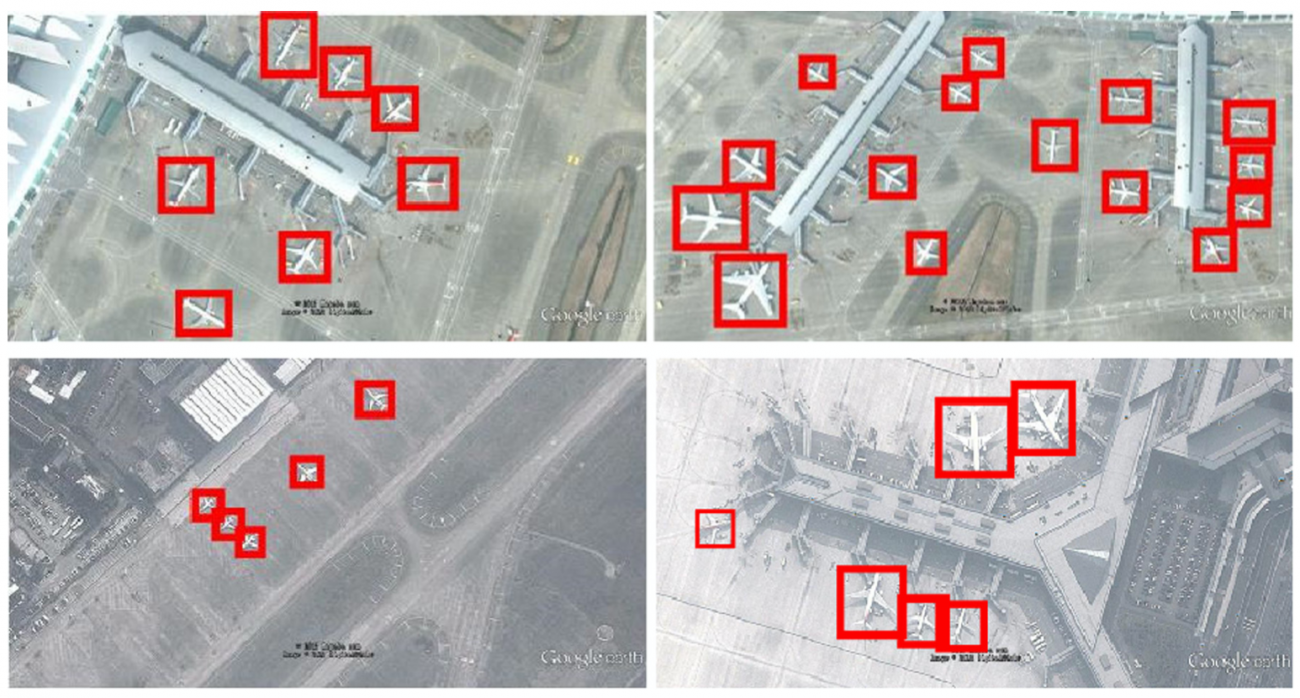

オブジェクト検出

深層学習を用いたオブジェクト検出をリモートセンシングに適用する際の課題として、トレーニングデータが少ないことに加えて、上空から観測しているため検出目標の物体が回転して観測されることがあります。例えば飛行機であれば機首が上を向いている場合もあれば、左や右、下を向いている場合があります。この回転問題を解決するため既存のCNNモデルに対して新しい層(rotation-invariant layer)を追加して学習し、船や飛行機の検出を含むマルチクラスオブジェクト検出のパフォーマンスを向上させる研究が行われています。この様に他の分野で成果を出している深層学習手法を適用する際の課題に対応するような研究が最近行われています(earning Rotation-Invariant Convolutional Neural Networks for Object Detection in VHR Optical Remote Sensing Images)。

他の例として精度向上や学習データが少なくても効率よく学習できるように、VGG16-Net等のモデルを転移学習する研究や(半)教師なし学習等の研究が行われています(A light and faster regional convolutional neural network for object detection in optical remote sensing images)。

その他、地震によって損傷した建物(Disaster damage detection through synergistic use of deep learning and 3D point cloud features derived from very high resolution oblique aerial images, and multiple-kernel-learning)、哺乳類(Detecting Mammals in UAV Images: Best Practices to address a substantially Imbalanced Dataset with Deep Learning)、アブラヤシ(Deep Learning Based Oil Palm Tree Detection and Counting for High-Resolution Remote Sensing Images)等を対象としたオブジェクト検出も行われており、リモートセンシングならではのオブジェクトを対象とした研究も行われています。

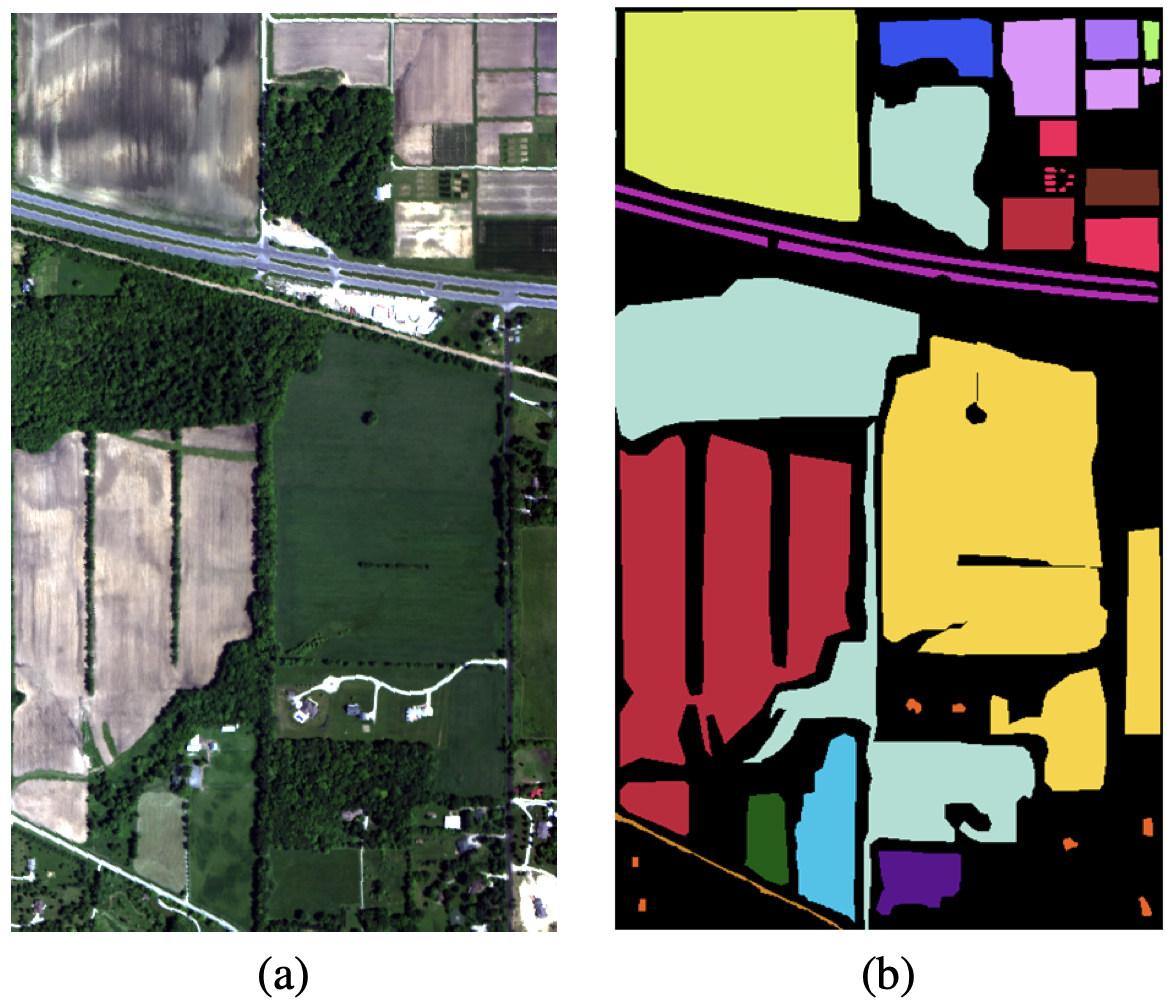

土地被覆・利用(LULC)分類

道路や作物の作付状況など、その場所が何の場所なのか分類するLULC分類はリモートセンシングの利用として盛んに研究されてきました。LULC分類で使用される深層学習モデルとしてDBNやAEが用いられて来ましたが、最近ではCNNやGANが最も注目されています。

さらに深層学習でLULC分類を行う際には、LULCを示す特徴構造を利用する必要があるため、高解像度画像がLULC分類に使用される傾向になってきています。一方で、LandsatやSentinel-2データなど、入手性の良い中解像度(10 m〜30 m)の衛星画像では通常の深層学習手法でLULC分類を行う事は難しいため、これら中分解能に最適化された深層学習モデルが研究されています(A patch-based convolutional neural network for remote sensing image classification)

。

また、これまでLULC分類は光学画像の分類に焦点を当てていましたが、DBNモデルを使用して合成開口レーダー(SAR)画像にLULC分類を適用する研究も行われています(Deep Learning for Remote Sensing Image Understanding) 。

LULC分類で深層学習に使用されるデータは、ほとんどの研究は単一の画像データのみを使用していますが、様々なリモートセンシングデータ(衛星データでないものも含めハイパースペクトルや高分解能データ、ライダーデータ、地形データなど)を使用する研究も出てきています(Multisource Remote Sensing Data Classification Based on Convolutional Neural Network)。

ただし、時間的に大量のデータが必要になりそのデータの入手性が悪いため、時系列のリモートセンシングデータを深層学習に用いる研究はあまりありません。

また、LULC分類として、都市マッピングが注目されています。しかし高分解能画像データが必要になることや分類対象領域が小さくなってしまうこと等から、深層学習を用いても精度と効率面でまだまだ課題があります(Stacked Sparse Autoencoder Modeling Using the Synergy of Airborne LiDAR and Satellite Optical and SAR Data to Map Forest Above-Ground Biomass)。

(赤:Wheat、黄色:Hay等に分類されている。詳細は元論文参照) Source : Multiclass feature learning for hyperspectral image classification: sparse and hierarchical solutions.

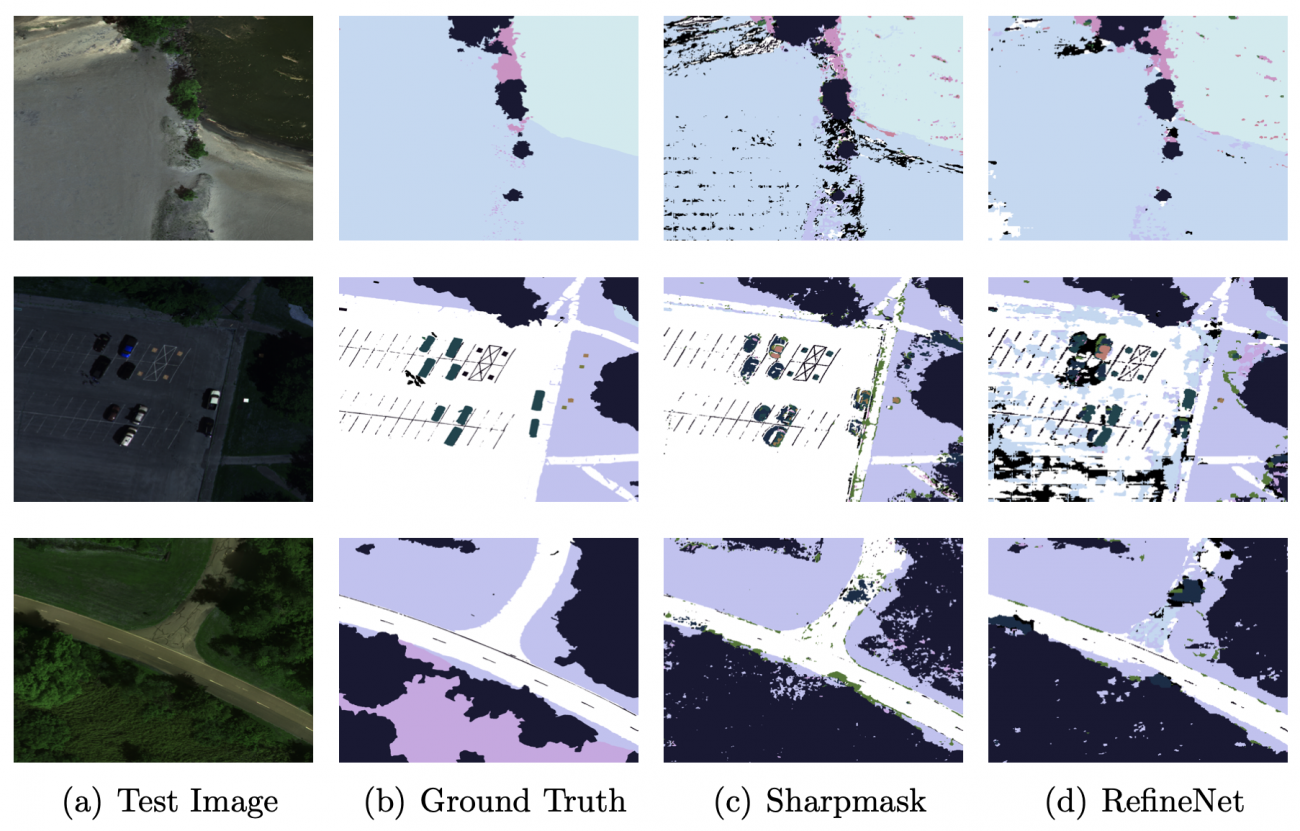

セマンティックセグメンテーション

セマンティックセグメンテーションは、画像の各ピクセルに土地被覆を割り当てることを目的としています。このリモートセンシング画像のセマンティックセグメンテーションに関心が近年高まっています。なお、前述のピクセルごと(pixel-by-pixel)に分類するLULC分類等と異なり、セマンティックセグメンテーションはある程度密な領域を分類します。

リモートセンシング画像のためのセマンティックセグメンテーションモデルは、空間的にマルチレベル(俯瞰からローカル)の特徴を探索するため、エンコーダーとデコーダーで構成されています。

しかし、この方法では出力の空間解像度が低くなるという犠牲が伴い、クラス境界が曖昧になります。そこで近年では「逆畳み込み畳み込み」「複数の解像度の組み合わせ」「デコーダーネットワークの改善」「複数のネットワークの使用」等を用いた研究が行われています。

特徴抽出と精細化はトレードオフの関係にあるため、非常に難しい課題となっています。さらに、目的によっては地理ラベルの多様さ、小さなオブジェクトの混在による精度低下、マルチモーダルデータの利用、転移学習等を使わない新しいモデルの学習などの課題もあります。

そのため、セマンティックセグメンテーションは一部のベンチマークデータでは優れた性能を発揮していますが、RIT-18等の難易度の高いベンチマークデータセットだと精度が出ない(Algorithms for semantic segmentation of multispectral remote sensing imagery using deep learning)等の課題があります。

と、課題を並べましたが、2次元的なデータだけでなく大規模な3Dシーンのセマンティックセグメンテーション(Fusion of images and point clouds for the semantic segmentation of large-scale 3D scenes based on deep learning)を行う研究や、建物の高さの抽出(Optimization of OpenStreetMap Building Footprints Based on Semantic Information of Oblique UAV Images)を行う研究など、セマンティックセグメンテーションのアプリケーションとして新しいものも出てきています。

(a)がリモートセンシングデータ、(b)が正解データ、(c)(d)は深層学習によるセグメンテーション結果。色分けは元論文参照。 Source : (Algorithms for Semantic Segmentation of Multispectral Remote Sensing Imagery using Deep Learningより)

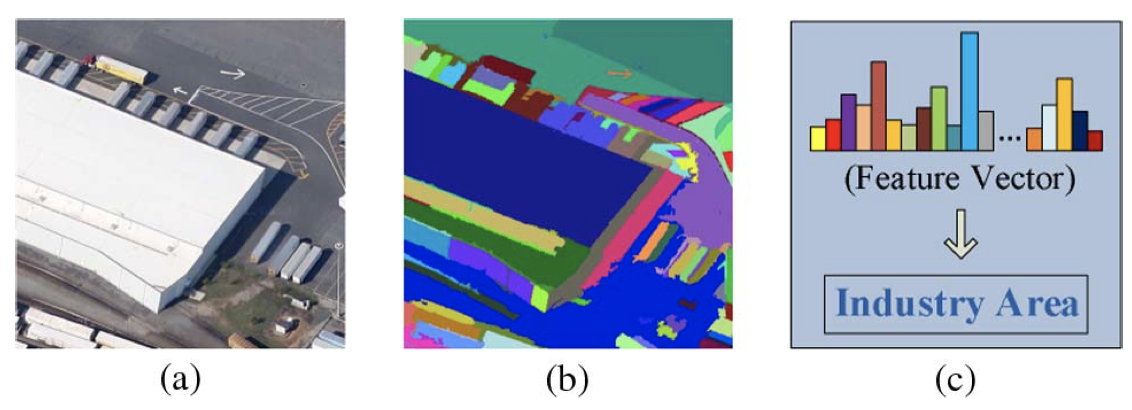

オブジェクトベース画像分類

オブジェクトベース画像分類は、画像を類似したピクセルの集合(segment)に分割して、このSegmentごとに分類を行う分類方法です。まずセグメンテーションを行い、そのセグメンテーション領域毎に分類する点で、分類まで行う前述のセグメンテーションとは若干異なります。近年ではこのオブジェクトベース分類の研究が行われています。

その他

その他の研究の例としては、DLによる土地被覆の検証にジオタグ付きの写真を使用して、LULCマッピング(Exploring geo-tagged photos for land cover validation with deep learning)する研究があります。このようなソーシャルネットワークメディアデータ(たとえば、位置情報付きの写真)を用いることで、リモートセンシング画像分類に使用できるトレーニングサンプルの数を簡単に増やす事ができます。

また、

・GANを利用して単一の光学画像からDSMを生成する研究(IMG2DSM: Height Simulation From Single Imagery Using Conditional Generative Adversarial Net)

・衛星と観測所の観測を融合することによるPM2.5の推定する研究(Estimating Ground‐Level PM2.5 by Fusing Satellite and Station Observations: A Geo‐Intelligent Deep Learning Approach)

・画像圧縮時のアーチファクトを低減する研究(One-two-one networks for compression artifacts reduction in remote sensing)

・ネットワークメディアデータ分析の研究(Social Media: New Perspectives to Improve Remote Sensing for Emergency Response)

・時系列分析の研究(A high-performance and in-season classification system of field-level crop types using time-series Landsat data and a machine learning approach)

・降水量データの検索する研究(A Deep Neural Network Modeling Framework to Reduce Bias in Satellite Precipitation Products)

などの新たな研究領域も出てきています。

見出しまとめを入れる(宙畑)

(4)リモートセンシングデータに深層学習を適用する際の課題

元論文の結論部分ではリモートセンシングデータに深層学習を適用する際の全体的な課題について述べられています。まとめると以下の課題が言及されています。

- ●教師あり深層学習モデルでは、大量の学習データが必要だが不足している。

- ●転移学習等のリモートセンシングデータに合わせた技術が必要。

- ●さまざまな深層学習アルゴリズムを比較するには、さまざまなリモートセンシング画像処理タスクおよびアプリケーション用の標準(ベンチマーク)データセットを作成する必要があるが、不足している(特に、中解像度および低解像度の衛星画像データ)。

- ●従来のリモートセンシングで盛んに行われてきた時系列的な研究にはあまり深層学習が適用されていない。これは時系列データの入手性が悪いため。

(5)「深層学習×リモートセンシング」研究のトレンド

ここまで論文「Deep learning in remote sensing applications: A meta-analysis and review」を通じて「深層学習×リモートセンシング」研究のトレンドをまとめてきました。ここからは前回の記事からどのようにトレンドが変化したか考えていきたいと思います、

「深層学習×リモートセンシング」研究対象の全体トレンド

2017年の論文解説記事と比較してみると、全く新たな研究対象が生まれて盛んに研究されてきているわけではなく、深層学習は前回記事と同じような「画像融合」「レジストレーション」「シーン分類」「オブジェクト検出」「土地被覆分類」が主な適用先となっています。

しかし、各分野で深層学習の利用が深化・高度化され、ベンチマークデータを用いた研究だけでなくデータ不足を補う水増し(Augmentation)に関する研究等の「実際に使うこと」を意識した研究が行われてきています。

前回の記事で指摘されていたような「リモセンデータが時系列かつ空間的で特殊であるため、他の分野で成果を出している深層学習モデルが使いにくい(新たな深層学習モデルを構築すべきだが、データが少ないので十分に学習出来ない)」という部分からは、深層学習を導入する際の課題が明確化しつつあり、各分野において研究が進んでいる印象です。

大きな課題:学習データの不足

2017年の論文および本論文でも言及されているように、依然として「学習データが不足していること」が大きな課題として指摘されています。特に本論文ではLULC分類精度がシーン分類やオブジェクト検出に対して精度が低いのはLULC分類の学習データ(ベンチマークデータ)が不足しているためではないか、と指摘されています。

例えば、一般的な深層学習を行うようなデータセットでは数万の画像が用意されていますが、衛星データの場合、同じ場所のデータセットは一日一回観測したとしても年間365枚しか収集できませんし、データを増やすために多くの場所を観測するには費用がかかります。また、本論文ではデータの取得性の悪さから時系列的な研究があまり進んでいないという指摘がありました。さらに学習データを作成するには正解データを作成しなければならないなど、学習データの整備には課題が山積しており、いかに整備するかは引き続き問題になりそうです。

一方、この学習データの不足に対してはデータの水増し(Augmentation)を行う事や、学習効率を上げるための転移学習、学習に必要なデータを減らす半教師付き学習等の研究も行われており、研究としても解決が模索されています。

2017年からの変化

前回の記事では以下の課題がありました。これらの課題に照らし合わせ、本論文との対応を考えてみます。

前回の記事にあった課題一覧

- ①「リモセン×深層学習」を行う目的として分類や物体検出以外あまりない

- ②リモセンデータは学習データが豊富になく、限られたトレーニングサンプルでより”深い”学習が可能かわらない

- ③リモートセンシングは基本的に物理的なプロセスによって観測されるが物理ベースのモデリングと深層学習の融合はあまり図られていない

- ④グローバルスケールで深層学習がリモセンデータに適用できるのかわからない

- ⑤リモセンデータが時系列かつ空間的で特殊であるため、他の分野で成果を出している深層学習モデルが使いにくい(新たな深層学習モデルを構築すべきだが、データが少ないので十分に学習出来ない)

①「リモセン×深層学習」を行う目的として分類や物体検出以外あまりない

分類と物体検出の大きなくくり方でいうと依然として目的の広がりはあまりないように思いました。しかし、各分野で個別の課題が確認され、より高度化されている様です。

②リモセンデータは学習データが豊富になく、限られたトレーニングサンプルでより”深い”学習が可能かわらない

こちらも依然として本論文でも指摘されています。しかしオブジェクト検出やシーン分類では一定程度整備されてきている様です。例えばこちらのページでデータセットがまとめられています。

③リモセンデータが時系列かつ空間的で特殊であるため、他の分野で成果を出している深層学習モデルが使いにくい(新たな深層学習モデルを構築すべきだが、データが少ないので十分に学習出来ない)

リモートセンシングに特化した新しいモデルが提案され始めていて、この課題は少し前進している印象です。

以下の課題については今回の論文では対応する記述がありませんでした。2017年から引き続き課題があるものと考えられます。

④グローバルスケールで深層学習がリモセンデータに適用できるのかわからない

⑤リモートセンシングは基本的に物理的なプロセスによって観測されるが物理ベースのモデリングと深層学習の融合はあまり図られていない

所感

今回の記事では2019年の論文を参照しました。前回の記事は2017年の論文をベースに執筆しましたが、2017年当時は「他でうまくいっている深層学習手法をとりあえず適用する」ような研究が多かったように思います。しかし2019年の本論文を読むと、前述の通り「リモートセンシングに深層学習に適用する際の固有の課題を解決していく研究」「実際に使う場合に生じる課題に対処する研究」といった様に、より利用を意識した研究が進んでいるように感じました。

一方で学習データの不足が依然として大きな課題になっています。一部、オブジェクト分類やシーン分類は充実してきており、LULC分類などの学習データが不足している領域でも次第に整備されていくトレンドを感じました。また2017年当時の適用領域は従来リモートセンシングで研究されてきた領域が主でしたが、単一の光学画像からDSM生成、PM2.5の推定、など新しい領域・研究対象での活用も模索されつつあります。

2年の間に他の分野で成果を上げている深層学習モデルの適用等が進んだことで課題が明らかとなり、現在は深層学習のリモートセンシング各研究対象内で各課題に対応するように深化していっている様です。今後もこのトレンドに注目していきたいと思います。